Kernpunkte:

- Forum Privatheit

- Digitale Arbeitswelten

- IuK-Forschung

8 Modellprojekte und Studien

Das Unabhängige Landeszentrum für Datenschutz hat als Behörde der Landesbeauftragten für Datenschutz seine Aktivitäten in Initiativen im Bereich drittmittelfinanzierter Projekte und Studien fortgesetzt. Damit ist das ULD weiterhin im Bereich der Kooperation mit der Wissenschaft aktiv und erhält die Möglichkeit, proaktiv an der Erforschung datenschutzspezifischer Fragen und der Gestaltung einschlägiger Technologien und Lösungen mitzuwirken. Im Berichtszeitraum wurden Projekte von der Europäischen Kommission und dem Bundesministerium für Bildung und Forschung (BMBF) gefördert.

Im Jahr 2021 beteiligte sich das ULD an Projekten zu aktuellen Themen in den Bereichen Privatheit und selbstbestimmtes Leben (Tz. 8.1), Datenschutz in digitalen Arbeitswelten (Tz. 8.2) sowie Datenschutz in der Technikforschung (Tz. 8.3) und setzt sein Engagement für Datenschutz, Transparenz- und Einwilligungsmanagement fort (Tz. 8.4).

8.1 Privatheit, Demokratie und Selbstbestimmung – Fortsetzung des Forum Privatheit

Die Digitalisierung lässt sich nicht aufhalten, aber gestalten – und das ist auch dringend notwendig. Dafür reicht es nicht aus, dass hier und da ein paar Forschende an Hochschulen ihre Gedanken und Ideen aufschreiben. Vielmehr braucht man für die wichtigen Fragen unserer Zeit eine interdisziplinäre Kooperation, und das nicht nur, aber auch im Bereich Datenschutz und Privatheit.

Im März 2021 ging unsere Mitarbeit im Forum Privatheit und selbstbestimmtes Leben in der Digitalen Welt zu Ende, ein interdisziplinäres Projekt, das insgesamt über sieben Jahre gelaufen ist. Unsere Arbeit zu wissenschaftlichen und gesellschaftspolitischen Herausforderungen hat viele Aspekte rund um Privatheit und Datenschutz berührt. Die Ergebnisse sind in Veröffentlichungen für Akteure im politischen Bereich (Policy Paper) und für Forschung, Anwendung und Nutzende (White Paper oder Forschungsberichte) dokumentiert.

Über die letzten vier Jahre haben die Projektpartner Schwerpunkte auf besondere Fokusthemen gelegt:

- 2017: Fortentwicklung des Datenschutzes

- 2018: Zukunft der Datenökonomie

- 2019: Inklusion und Exklusion

- 2020: Selbstbestimmung und Privatheit – Gestaltungsoptionen für einen europäischen Weg

Die Abschlussarbeiten Anfang 2021 beschäftigten sich insbesondere mit ganzheitlich gestalteten Lösungen für einen weiter gedachten Datenschutz „by Design“ (siehe Tz. 2.4). Das letzte Projektjahr war außerdem von der Diskussion zu Wirkungen und Auswirkungen der Instrumente zur Pandemiebekämpfung geprägt. In diesem Zusammenhang wurde auch mit einem Team von Expertinnen und Experten zusammengearbeitet, die von der Nationalen Akademie der Wissenschaften Leopoldina eingeladen wurden. Die aus zahlreichen Gesprächen entstandene Publikation „Ansatzpunkte für eine Stärkung digitaler Pandemiebekämpfung“ (Diskussion Nr. 25, 2021) ist unter dem folgenden Link abrufbar:

https://www.leopoldina.org/publikationen/detailansicht/publication/ansatzpunkte-fuer-eine-staerkung-digitaler-pandemiebekaempfung-2021/ [Extern]

Kurzlink: https://uldsh.de/tb40-8-1a

Nach Abschluss unserer Mitwirkung im Forum Privatheit geht die Arbeit im Nachfolgeprojekt „PRIDS – Privatheit, Demokratie und Selbstbestimmung im Zeitalter von Künstlicher Intelligenz und Globalisierung“ weiter. In dem PRIDS-Projekt beschäftigen wir uns u. a. mit Effekten der künstlichen Intelligenz und deren Beherrschbarkeit (Tz. 6.1.2), mit Risiken für die Rechte und Freiheiten natürlicher Personen in den verschiedenen Konstellationen, mit möglichen gesellschaftlichen Folgen der Digitalisierung sowie mit dem Thema Überwachungsgesamtrechnung (Tz. 2.3).

Die Ergebnisse werden weiterhin über die bekannte Webseite des Forum Privatheit bereitgestellt:

https://www.forum-privatheit.de/ [Extern]

Was ist zu tun?

Für die großen Herausforderungen, die mit der zunehmenden Digitalisierung für Einzelpersonen und unsere Gesellschaft verbunden sind, braucht es eine verstärkte interdisziplinäre Zusammenarbeit.

8.2 Projekt EMPRI-DEVOPS – Datenschutz in digitalen Arbeitswelten

Das Projekt „Employee Privacy in Software Development and Operations“ (EMPRI-DEVOPS) (39. TB, Tz. 8.2) beschäftigt sich mit dem datenschutzkonformen Einsatz von Softwaretools in der Arbeitswelt. Projektziel ist die datenschutzkonforme Gestaltung von Softwareprodukten, die typischerweise im Kontext der agilen Softwareprogrammierung und der Systemadministration zum Einsatz kommen. Lehren aus diesem speziellen Anwendungsfeld lassen sich jedoch auf den Einsatz anderer Kooperationstools und Office-Umgebungen verallgemeinern.

In einem früheren Tätigkeitsbericht haben wir bereits darauf hingewiesen, dass bei Auswahl, Konfiguration und Betrieb von Softwareprodukten die Risiken ermittelt und berücksichtigt werden sollten (38. TB, Tz. 8.2). Eine umfassende Erhebung und Bewertung von Risiken für eine Verarbeitung kann im Rahmen einer Datenschutz-Folgenabschätzung (DSFA) geschehen. Ein Schritt einer DSFA ist es, die Risikoquellen zu identifizieren – in der Informatik spricht man hier vom Angreifermodell. Erfolgt die DSFA für den Einsatz von Software in Beschäftigungsverhältnissen, ist auch an das Unternehmen selbst bzw. dessen Leitung und die Vorgesetzten als Risiko zu denken. Diese können etwa übermäßig anfallende Metadaten oder systembedingt vorhandene Zugriffs- und Kontrollmöglichkeiten erheben, auswerten und so missbräuchlich verwenden. Solche „Angreifer“ können zudem aus dem Kollegium stammen, wenn ihnen der Zugriff auf entsprechende Daten möglich ist. Derartige Risiken potenzieren sich, wenn diese Informationen über lange Zeiträume kontinuierlich verfügbar sind und sich so komplette detaillierte Profile über Tätigkeiten – und damit Verhalten oder Leistung – von Beschäftigten erstellen lassen. Sofern solche Risiken nicht systemseitig ausgeschlossen werden können, ist ihnen durch geeignete technische und organisatorische Maßnahmen zu begegnen.

Die technischen Partner im Projekt haben exemplarisch für die Versionskontrolle mittels des weitverbreiteten Versionskontrollsystems Git Lösungen dafür erarbeitet, Zeitstempel zentral zu kürzen oder zumindest deren Darstellung lokal zu vergröbern. Statt sekundengenauer Angaben wären diese dann beispielsweise nur noch taggenau ablesbar.

Dieser Ansatz lässt sich für andere Anwendungsfälle verallgemeinern: Ist lediglich eine Reihenfolge von Beiträgen oder Eingängen relevant, könnten Zeitstempel durch Sequenz- oder Tagebuchnummern ersetzt werden. Ist zur weiteren Bearbeitung nur eine fachliche Zugehörigkeit von früheren Bearbeitenden relevant und sind auch Rückfragen bei konkreten Einzelpersonen die Ausnahme, könnten namentliche Kennungen durch Abteilungsnamen oder Teambezeichnungen ersetzt werden. Liegt die zu verwendende Software in geeigneter Lizenz vor, bestünde bei großen Arbeitgebern die Möglichkeit, vergleichbare Anpassungen für im Informationsgehalt überschießende Metadaten selbst vorzunehmen oder dies bei den Entwicklungsteams für künftige Versionen zu beauftragen. Gerade öffentliche Arbeitgeber könnten so eine Vorbildfunktion einnehmen, indem beim Beschäftigtendatenschutz (siehe auch Tz. 2.6) schon bei grundlegenden Verarbeitungen auf Prinzipien wie Datenminimierung geachtet wird.

Für eine realistische Folgenabschätzung im Zusammenhang von Softwareeinsatz am Arbeitsplatz genügt es nicht, nur solche Daten zu betrachten, die offensichtlich personenbezogen sind, wie Stamm- oder Profildaten von Beschäftigten. Vielmehr sind alle Anwendungsdaten zu betrachten, die unmittelbar oder über eine Verkettung einen Personenbezug zu einzelnen Beschäftigten aufweisen. Entstehen die Metadaten und Informationen über die Nutzung nicht unternehmensintern, sondern bei einem Austausch mit externen Stellen, müssen auch diese Daten in den Blick genommen werden. Wird etwa in Projekten unternehmensübergreifend mit einer Software zum Informationsaustausch gearbeitet, bestünden vergleichbare Auswertungsoptionen bei allen Zugriffsberechtigten – und das können neben dem Betreiber einer solchen Infrastruktur auch alle beteiligten Stellen sein.

Wo technische Abhilfemaßnahmen nicht zur Verfügung stehen, können flankierende organisatorische Maßnahmen helfen, unzulässige Zugriffe für Leistungs- und Verhaltenskontrollen zu verhindern. Das können beispielsweise Betriebsvereinbarungen oder hilfsweise Selbstverpflichtungen der Arbeitgeber und entsprechende Weisungen und Schulung der Beschäftigten sein.

8.3 Projekt PANELFIT – Datenschutz und Ethik in der europäischen IuK-Forschung

Das von der EU-Kommission geförderte Projekt „Participatory Approaches to a New Ethical and Legal Framework for ICT“ (PANELFIT) (39. TB, Tz. 8.3) zielt darauf ab, dass Neuerungen durch die DSGVO schnell und vollständig von allen europäischen Akteuren im Bereich der Forschung zu Informations- und Kommunikationstechnologien (IuK) aufgegriffen und umgesetzt werden können. Ein Schwerpunkt der Tätigkeit des ULD-Teams im Projekt war eine Ausarbeitung zu Identifizierung und Identifizierbarkeit von Personen. Dies ist ebenso relevant für die Bestimmung eines Personenbezugs wie für die Bewertung der Effektivität von Schutzmaßnahmen wie Anonymisierung und Pseudonymisierung. Zu der Arbeit gehörte zunächst, eine Übersicht von technischen Verfahren zu erstellen, die für eine Anonymisierung zum Einsatz kommen können, und sie zu kategorisieren. Außerdem wurden die rechtlichen Normen der DSGVO analysiert.

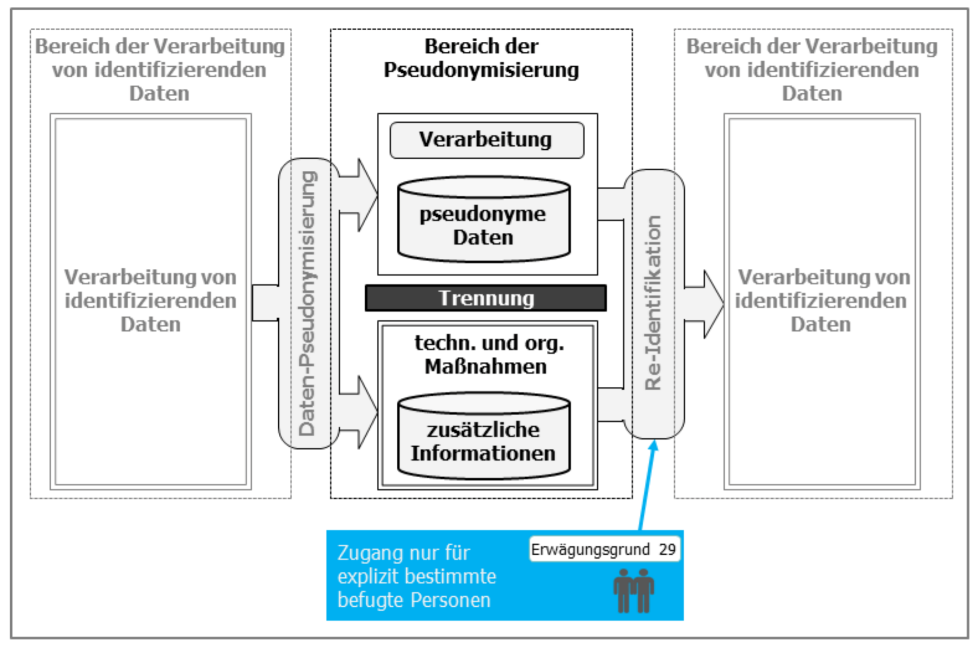

Pseudonymisierung nach der DSGVO im Schaubild

Da das Projekt PANELFIT vor allem auf datenintensive Forschung im IuK-Bereich abzielt, bestand eine Herausforderung darin, diese Grundsätze und Regelungen der DSGVO einem Publikum mit primär naturwissenschaftlich-technischem Hintergrund zugänglich zu machen. Besonderes Augenmerk galt präzisen, aufeinander aufbauenden und kompatiblen Definitionen aller wichtigen Konzepte im Sinne einer Terminologie oder sogar Ontologie.

Exemplarisch sei hier etwa die klarstellende Herausarbeitung der Unterschiede zwischen einer Pseudonymisierung im Sinne der DSGVO, die bestimmten Anforderungen genügen muss, und den im üblichen Sprachgebrauch allgemein als Pseudonymisierung bezeichneten Verarbeitungen genannt. Zu den Anforderungen der DSGVO an eine Pseudonymisierung gehört insbesondere, dass die von den identifizierenden Informationen getrennten Daten nur in einem gesicherten Umfeld verarbeitet werden dürfen und dass die Trennung der zur Re-Identifikation erforderlichen „zusätzlichen Informationen“ gewährleistet ist. Ausschließlich zuständige Personen dürfen Zugriff auf letztgenannte Daten haben (siehe Abbildung).

Der Personenbezug der pseudonymisierten Daten bleibt bestehen. Regelmäßig sind die pseudonymisierten Daten weiterhin mit angemessenen technischen und organisatorischen Maßnahmen zu schützen, wobei das zu gewährleistende Schutzniveau im Vergleich mit dem der ursprünglichen nichtpseudonymisierten Daten aber zumeist als niedriger einzustufen ist.

Ein weiterer Schwerpunkt in der Projektarbeit lag auf dem Prinzip von Datenschutz durch Technikgestaltung und durch datenschutzfreundliche Voreinstellungen („Data Protection by Design and by Default“, DPbDD). Zusätzlich zu der Analyse des Gesetzestextes wurden die Prozesse zur Implementierung von DPbDD in jeder der identifizierten Phasen einer Verarbeitungstätigkeit analysiert. Dies hilft den praxisorientierten Adressaten des Projekts, das Prinzip von DPbDD effizient umzusetzen.

Schließlich hat das ULD-Team im PANELFIT-Projekt zu einer vergleichenden Länderstudie zu Datenschutz im Forschungsbereich sowie zu Cybersecurity beigetragen. Die im Berichtsjahr erarbeiteten Beiträge zu Identifizierbarkeit und DPbDD sowie diejenigen des Vorjahres (GDPR in a Nutshell, Principles, Documentation of Processing, DPIA (Datenschutz-Folgenabschätzung), siehe 39. TB, Tz. 8.3) wurden nach einem zweistufigen Reviewprozess in eine konsolidierte Fassung überführt und werden als Kapitel für die PANELFIT-Leitfäden verwendet. Diese werden derzeit in mehrere Sprachen übersetzt und sollen sowohl in gedruckter Form als auch online vom Projekt publiziert werden.

Die im Projekt erstellten Texte und das gewonnene Wissen werden vom ULD in die Datenschutz-Community getragen, etwa mit dem Ziel, zu einem gemeinsamen Verständnis der Konzepte von Pseudonymisierung und Anonymisierung in Europa beizutragen.

Die Studie zur Identifizierbarkeit sowie die weiteren Projektergebnisse sind unter den folgenden Links verfügbar:

Was ist zu tun?

In Forschungsprojekten, die auf einer umfangreichen Datenverarbeitung beruhen, sollte das Verständnis zum Datenschutz verbessert werden. Einen Beitrag zu der dafür notwendigen „Übersetzung“ der Anforderungen aus der DSGVO will das Projekt PANELFIT leisten. Es gilt, diese Aufbereitung für die Praxis fortzusetzen.

8.4 Projekt TRAPEZE – Transparenz- und Einwilligungsmanagement für das semantische Netz

Das Projekt „TRAnsparency, Privacy and security for European citiZEns“ (TRAPEZE) wird von der EU-Kommission gefördert und widmet sich der Entwicklung von Lösungen für Datenschutz und Transparenz in der „Data Economy“ (39. TB, Tz. 8.4). Auf europäischer Ebene werden zurzeit die Weichen dafür gestellt, dass Daten für Forschungszwecke und Wirtschaft verstärkt verfügbar sein sollen. Gleichzeitig wird die Geltung der DSGVO nicht infrage gestellt – Datenschutz bleibt also auch weiterhin ein wichtiger Eckpfeiler. Mit dem geplanten europäischen „Data Governance Act“ (DGA) sollen Möglichkeiten geschaffen werden, Dienste zur gemeinsamen Datennutzung einzurichten. Betroffene Personen können ihre eigenen Daten im Rahmen von „Datenaltruismus“ für „Zwecke von allgemeinem Interesse“ zur Verfügung stellen.

Im Entwurf des Data Governance Acts wird Datenaltruismus definiert. Betroffene Personen sollen eine Einwilligung erteilen können zur Verarbeitung ihrer Daten für Zwecke von allgemeinem Interesse, etwa für wissenschaftliche Forschung oder die Verbesserung öffentlicher Dienstleistungen.

Mit den Regelungen des DGA deutet sich in Teilen ein Richtungswechsel an: Gegenwärtig wird in Deutschland nach überwiegender Rechtsauffassung angenommen, dass eine Einwilligung im Datenschutz nur selbst (höchstpersönlich) oder durch einen gesetzlichen Vertreter erteilt werden könne. Das wird aus dem höchstpersönlichen Charakter des Rechts auf informationelle Selbstbestimmung abgeleitet. Aus den eher strikten und umfassenden Bedingungen an die Bestimmtheit einer informierten Einwilligung resultieren Hürden etwa für die Verwendung bereits vorhandener Daten für Sekundärzwecke. Diese Sekundärzwecke betreffen nicht nur eine wirtschaftliche Auswertung personenbezogener Daten, sondern können etwa bei Forschung allgemein anerkannter Interessen oder anderen Zwecken, die die jeweils betroffene Person unterstützen möchte, liegen.

Im TRAPEZE-Projekt spielt das Verständnis der Einwilligung und der Ansätze, eine Einwilligung nicht nur höchstpersönlich erteilen zu können, eine wesentliche Rolle. Beispielsweise könnten Stellvertreter, Treuhänder oder Informationstechnik zum Einsatz kommen, um ein Einwilligungsmanagement zu gewährleisten oder zu unterstützen. Sinnvoll ist hierbei eine europäische Harmonisierung. Dabei sind die wesentlichen Kernpunkte der Einwilligung vorab zu bestimmen und verständlich mitzuteilen, namentlich die Kategorien von Empfängern, Daten, Zwecken und Verarbeitungsarten. Schließlich müssen auch besondere Modalitäten und Beschränkungen bestimmt werden können – etwa eine Einschränkung auf Weitergaben und Verarbeitungen im Anwendungsbereich der DSGVO.

Bausteine für eine mögliche Umsetzung einer technisch unterstützten Einwilligung unter Kontrolle der betroffenen Person werden u. a. im TRAPEZE-Projekt entwickelt. Sowohl für automatische als auch menschliche Entscheidungen über die Verarbeitung anvertrauter Daten ist eine maschinenlesbare Abbildung der geplanten oder zu gestattenden Verarbeitung nötig (Policy). Die Grundlagen für ein derartiges Policy-Vokabular wurden bereits im Vorgängerprojekt SPECIAL unter dem Dach des W3C gelegt (dazu 39. TB, Tz. 8.4) und werden gegenwärtig im TRAPEZE-Projekt weiterentwickelt. So wäre es damit möglich, Einwilligungen für Sekundärnutzungen sinnvoll zu bedingen oder zu begrenzen. Diese Informationen zu Reichweite und Grenzen der Einwilligung könnten direkt mit den jeweiligen personenbezogenen Daten verarbeitet oder übermittelt werden. Dies wäre nicht zuletzt ein Mehrwert u. a. für das von der EU eingeführte Konzept des Datenaltruismus.

Daneben stehen weitere Forschungsbereiche des Projekts wie die Erarbeitung einer Benutzungsoberfläche, die alle datenschutzrelevanten Aspekte klar und verständlich darzustellen vermag. Wünschenswert wäre es, den Nutzenden zu ersparen, sich für jede Plattform erneut in die jeweilige Darstellungsweise einzuarbeiten. Dies ließe sich beispielsweise mit einer annähernden Vereinheitlichung entsprechender Benutzungsoberflächen oder mit einer standardisierten maschinenlesbaren Policy erreichen, sodass die Nutzenden eine beabsichtigte Verarbeitung in der gewohnten Umgebung einer eigenen App anzeigen oder computerunterstützt für sich selbst auswerten können.

Insgesamt bleibt es spannend. Die gegenwärtig in Europa entwickelten Lösungen zum Datenschutz durch Technikgestaltung können relevante Beiträge leisten, um eine europäische „Data Economy“ auch für personenbezogene Daten sicher, vertrauenswürdig und fair zu gestalten. Zugleich sind die Gesetzgeber auf europäischer und nationaler Ebene gefragt, den Einsatz solcher Lösungen rechtssicher zu regeln und damit die nötigen Leitplanken für die weiteren Entwicklungen – auch im Sinne des Gemeinwohls – zu geben.

https://www.datenschutzzentrum.de/projekte/trapeze/

| Zurück zum vorherigen Kapitel | Zum Inhaltsverzeichnis | Zum nächsten Kapitel |